Ollama

捆绑包 (Bundles) 包含支持特定第三方与 Langflow 集成的自定义组件。

本页面介绍了 Ollama 捆绑包中可用的组件。

有关 Ollama 组件使用的 Ollama 特性和功能的更多信息,请参阅 Ollama 文档。

Ollama 文本生成 (Ollama text generation)

该组件使用 Ollama 的语言模型 生成文本。

要在流中使用 Ollama 组件,请将 Langflow 连接到您本地运行的 Ollama 服务器并选择一个模型:

-

将 Ollama 组件添加到您的流中。

-

在 Base URL 字段中,输入您本地运行的 Ollama 服务器地址。

此值在 Ollama 中被设置为

OLLAMA_HOST环境变量。 默认基准 URL 为http://127.0.0.1:11434。 -

建立连接后,在 Model Name 字段中选择一个模型,例如

llama3.2:latest。要刷新服务器的模型列表,请点击 刷新 (Refresh)。

-

可选:要配置其他参数(如温度或最大 token 数),请点击组件标题菜单中的 控制 (Controls)。

-

将 Ollama 组件连接到流中的其他组件,具体取决于您想如何使用该模型。

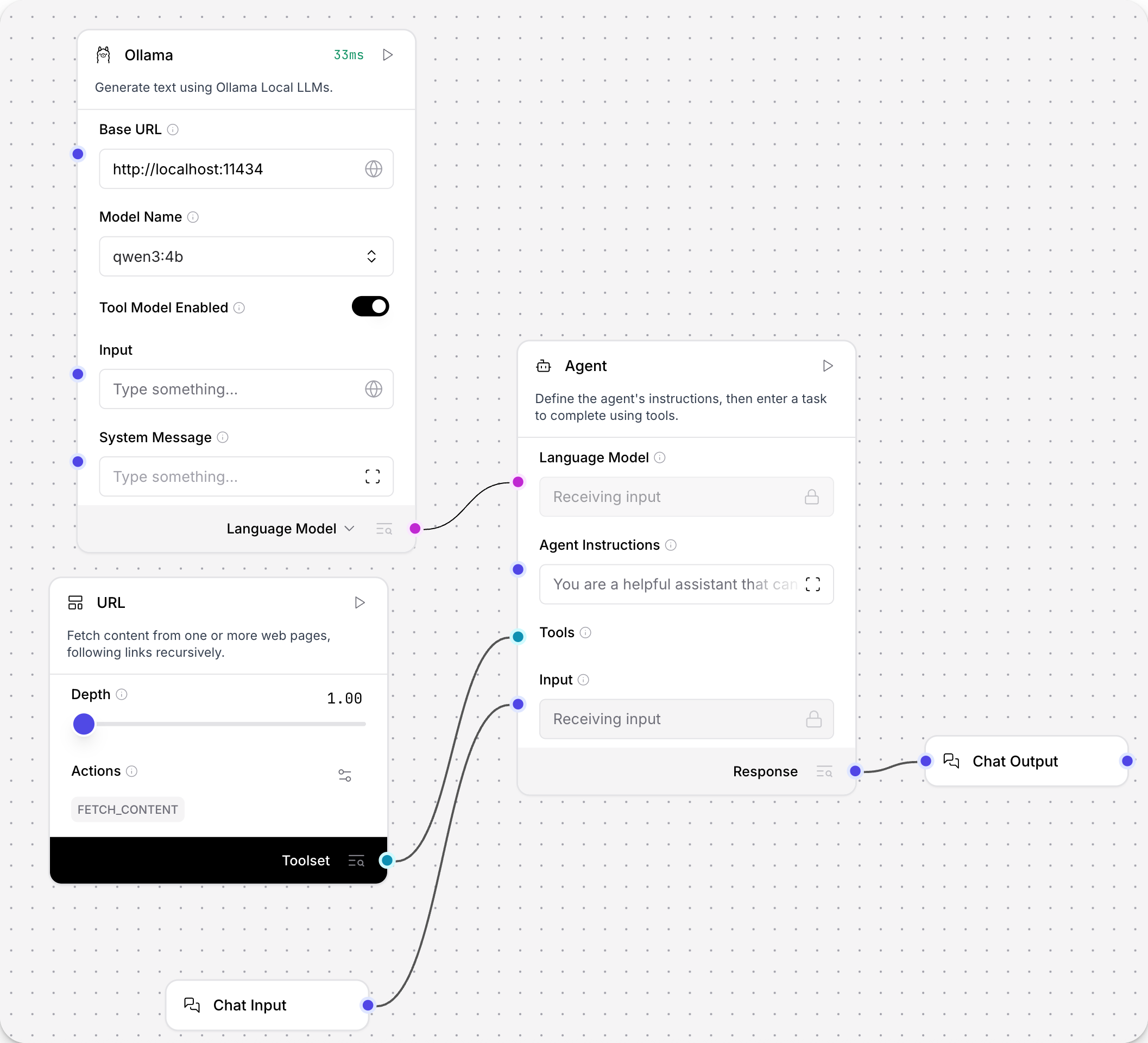

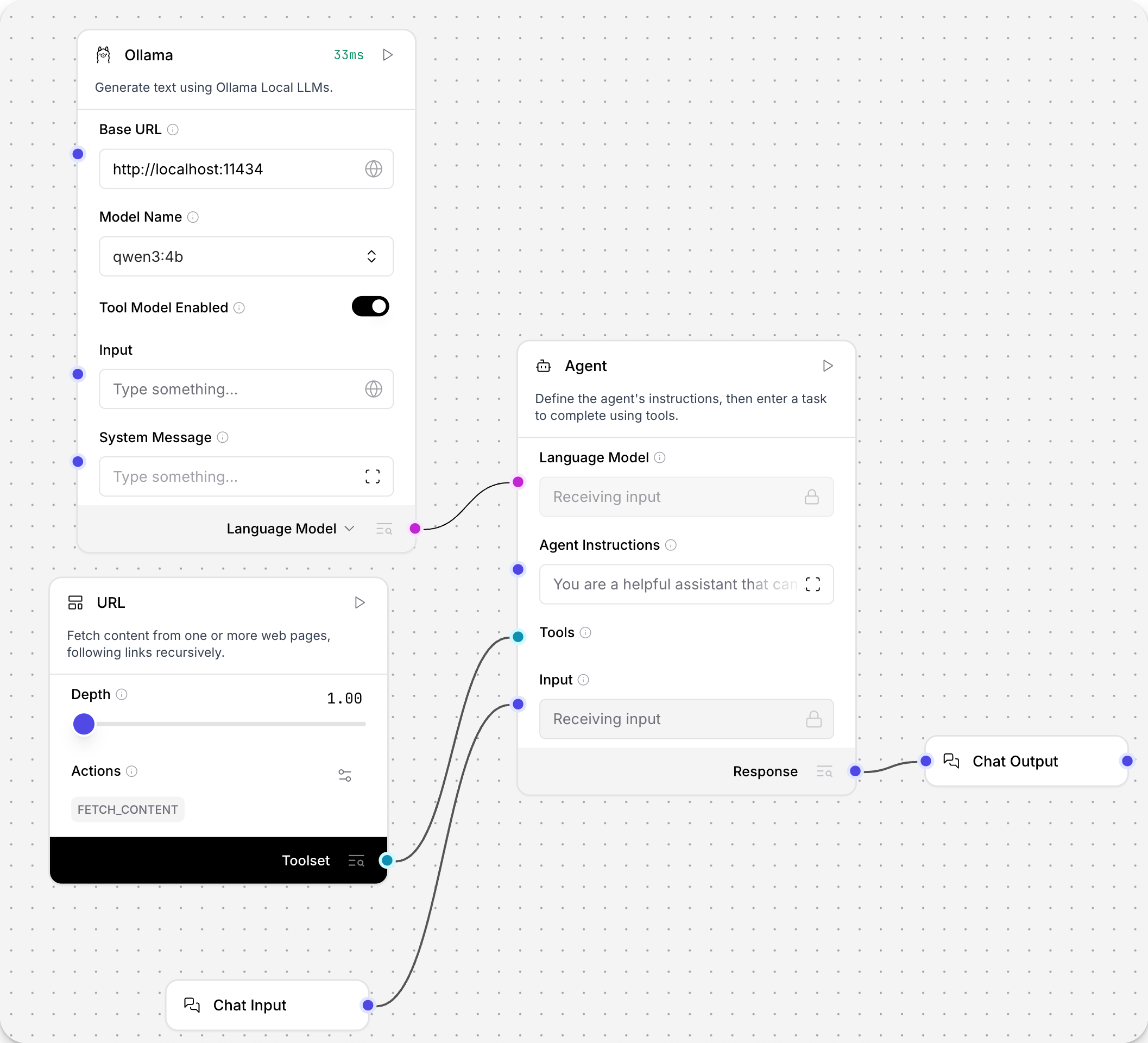

语言模型组件可以输出 模型响应 (Model Response) (

Message) 或 语言模型 (Language Model) (LanguageModel)。当您想将 Ollama 模型用作另一个由 LLM 驱动的组件(如 代理 (Agent) 或 智能转换 (Smart Transform) 组件)的 LLM 时,请使用 语言模型 输出。有关更多信息,请参阅 语言模型组件。在以下示例中,该流使用

LanguageModel输出,将 Ollama 模型用作 代理 (Agent) 组件 的 LLM。

Ollama 嵌入 (Ollama Embeddings)

Ollama Embeddings 组件使用 Ollama 嵌入模型 生成嵌入。

要�在流中使用此组件,请将 Langflow 连接到您本地运行的 Ollama 服务器并选择一个嵌入模型:

-

将 Ollama Embeddings 组件添加到您的流中。

-

在 Ollama Base URL 字段中,输入您本地运行的 Ollama 服务器地址。

此值在 Ollama 中被设置为

OLLAMA_HOST环境变量。 默认基准 URL 为http://127.0.0.1:11434。 -

建立连接后,在 Ollama Model 字段中选择一个模型,例如

all-minilm:latest。要刷新服务器的模型列表,请点击 刷新 (Refresh)。

-

可选:要配置其他参数(如温度或最大 token 数),请点击组件标题菜单中的 控制 (Controls)。 可用参数取决于所选模型。

-

将 Ollama Embeddings 组件连接到流中的其��他组件。 有关在流中使用嵌入模型组件的更多信息,请参阅 嵌入模型组件。

此示例连接了 Ollama Embeddings 组件,为从 PDF 文件中提取的文本块生成嵌入,然后将嵌入和块存储在 Chroma DB 向量存储中。