Cleanlab

Cleanlab 为进入 AI 和 RAG 解决方案的每个数据点以及从中出来的每一个预测增加了自动化和信任。

使用 Cleanlab 组件将 Cleanlab Evaluations 与 Langflow 集成,并通过 Cleanlab 的评估和修复套件解锁值得信赖的代理、RAG 和 LLM 管道。

您可以使用这些组件以 0 到 1 之间的分数来量化任何 LLM 响应的可信度,并解释为什么响应可能是好的或坏的。对于带有上下文的 RAG 或代理管道,您可以使用量化分数评估上下文充分性、扎实性、有用性和查询清晰度。此外,您可以使用警告或回退答案来修复低可信度的响应。

需要使�用 Cleanlab API 密钥进行身份验证。

Cleanlab 评估器 (Cleanlab Evaluator)

Cleanlab 评估器 组件使用 Cleanlab 评估并解释提示词和响应对的可信度。有关分数如何工作的更多信息,请参阅 Cleanlab 文档。

Cleanlab 评估器参数

Some parameters are hidden by default in the visual editor. You can modify all parameters through the Controls in the component's header menu.

| 名称 | 类型 | 描述 |

|---|---|---|

| system_prompt | Message | 输入参数。置于提示词之前的系统消息。可选。 |

| prompt | Message | 输入参数。面向用户的 LLM 输入。 |

| response | Message | 输入参数。要评估的模型响应。 |

| cleanlab_api_key | Secret | 输入参数。您的 Cleanlab API 密钥。 |

| cleanlab_evaluation_model | Dropdown | 输入参数。Cleanlab 使用的评估模型,例如 GPT-4 或 Claude。这不需要与生成响应的模型相同。 |

| quality_preset | Dropdown | 输入参数。在评估速度和准确性之间进行权衡。 |

Cleanlab 评估器输出

Cleanlab 评估器 组件有三个可能的输出。

| 名称 | 类型 | 描述 |

|---|---|---|

| score | number, float | 显示 0 到 1 之间的可信度分数。 |

| explanation | Message | 提供可信度分数的解释。 |

| response | Message | 返回原始响应,以便轻松链接到 Cleanlab 修复器 (Cleanlab Remediator) 组件。 |

Cleanlab 修复器 (Cleanlab Remediator)

Cleanlab 修复器 组件使用来自 Cleanlab 评估器 组件 的可信度分数来决定是显示、警告还是替换 LLM 响应。

此组件具有分数阈值、警告文本和回退消息的参数,您可以根据��需要进行自定义。

输出是 修复后的响应 (remediated_response),这是一个 Message,包含在应用修复逻辑后显示给用户的最终消息。

Cleanlab 修复器参数

| 名称 | 类型 | 描述 |

|---|---|---|

| response | Message | 输入参数。可能需要修复的响应。 |

| score | Number | 输入参数。来自 CleanlabEvaluator 的可信度分数。 |

| explanation | Message | 输入参数。如果显示警告,则附加解释。可选。 |

| threshold | Float | 输入参数。保持响应不变通过的最小可信度分数。 |

| show_untrustworthy_response | Boolean | 输入参数。如果响应被认为不可信,是否显示或隐藏带有警告的原始响应。 |

| untrustworthy_warning_text | Prompt | 输入参数。不可信响应的警告文本。 |

| fallback_text | Prompt | 输入参数。如果响应被隐藏,则显示的回退消息。 |

Cleanlab RAG 评估器 (Cleanlab RAG Evaluator)

Cleanlab RAG 评估器 组件使用 Cleanlab 的评估指标 评估 RAG 和 LLM 管道��输出的可信度、上下文充分性、响应扎实性、有用性和查询便捷性。

您可以将此组件与 Cleanlab 修复器 组件 配对,以修复来自 RAG 管道的低可信度响应。

Cleanlab RAG 评估器参数

Some parameters are hidden by default in the visual editor. You can modify all parameters through the Controls in the component's header menu.

| 名称 | 类型 | 描述 |

|---|---|---|

| cleanlab_api_key | Secret | 输入参数。您的 Cleanlab API 密钥。 |

| cleanlab_evaluation_model | Dropdown | 输入参数。Cleanlab 使用的评估模型,例如 GPT-4 或 Claude。这不需要与生成响应的模型相同。 |

| quality_preset | Dropdown | 输入参数。在评估速度和准确性之间进行权衡。 |

| context | Message | 输入参数。从您的 RAG 系统检索到的上下文。 |

| query | Message | 输入参数。原始用户查询。 |

| response | Message | 输入参数。模型基于上下文和查询给出的响应。 |

| run_context_sufficiency | Boolean | 输入参数。评估上下文是否支持回答查询。 |

| run_response_groundedness | Boolean | 输入参数。评估响应是否扎根于上下文中。 |

| run_response_helpfulness | Boolean | 输入参数。评估响应的有用程度。 |

| run_query_ease | Boolean | 输入参数。评估查询是否模糊、复杂或具有对抗性。 |

Cleanlab RAG 评估器输出

Cleanlab RAG 评估器 组件具有以下输出选项:

| 名称 | 类型 | 描述 |

|---|---|---|

| trust_score | Number | 总体可信度分数。 |

| trust_explanation | Message | 可信度分数的解释。 |

| other_scores | Dictionary | 可选启用的 RAG 评估指标字典。 |

| evaluation_summary | Message | 查询、上下文、响应和评估结果的 Markdown 摘要。 |

| response | Message | 返回原始响应,以便轻松链接到 Cleanlab 修复器 (Cleanlab Remediator) 组件。 |

Cleanlab 流示例

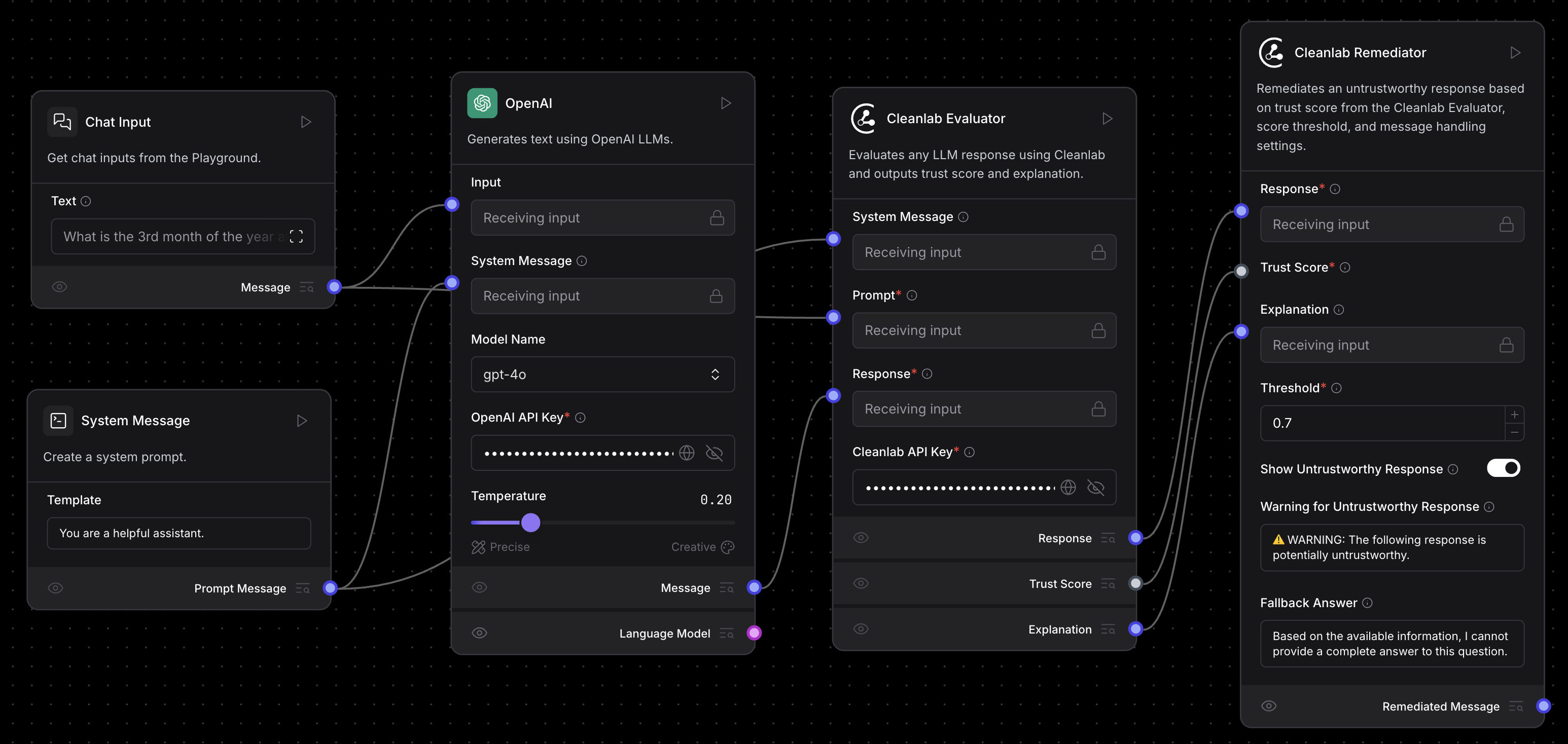

以下示例流显示了如何使用 Cleanlab 评估器 和 Cleanlab �修复器 组件来评估和修复来自任何 LLM 的响应,以及如何使用 Cleanlab RAG 评估器 组件来评估 RAG 管道输出。

评估并修复来自 LLM 的响应

此流使用 Cleanlab 评估器 和 Cleanlab 修复器 组件评估并修复来自任何 LLM 的响应的可信度。

您可以 下载评估和修复流,然后将 流导入 到您的 Langflow 实例。 或者,您可以通过连接以下组件从头开始构建流:

- 将任何 语言模型 (Language Model) 或 代理 (Agent) 组件的

Message输出连接到 Cleanlab 评估器 组件的 Response 输入。 - 将 提示模板 (Prompt Template) 组件连接到 Cleanlab 评估器 组件的 Prompt 输入。

运行流时,Cleanlab 评估器 组件会返回流的可信度分数和解释。

Cleanlab 修复器 组件使用此可信度分数来决定是输出原始响应、对其发出警告,还是将其替换为回退答案。

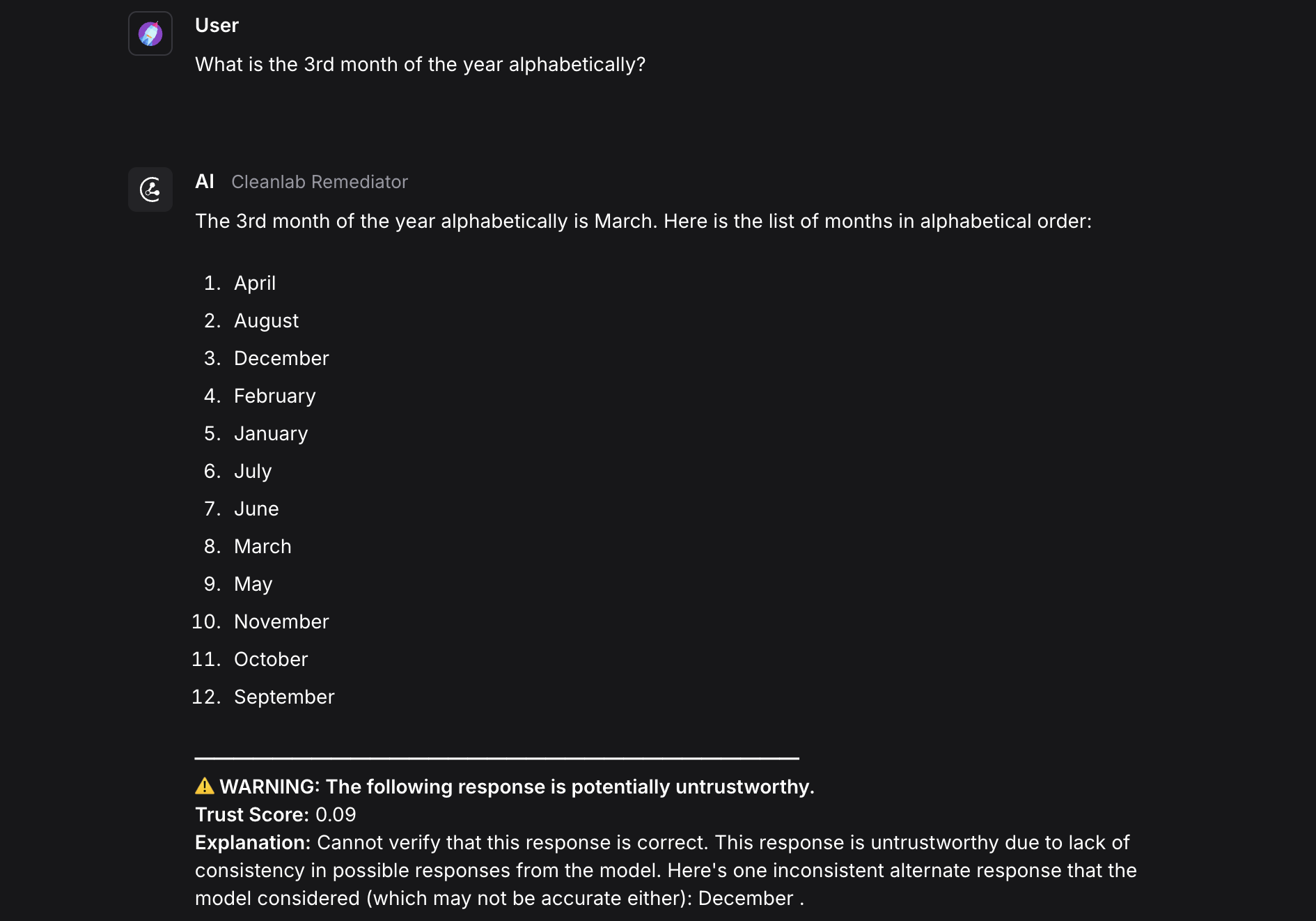

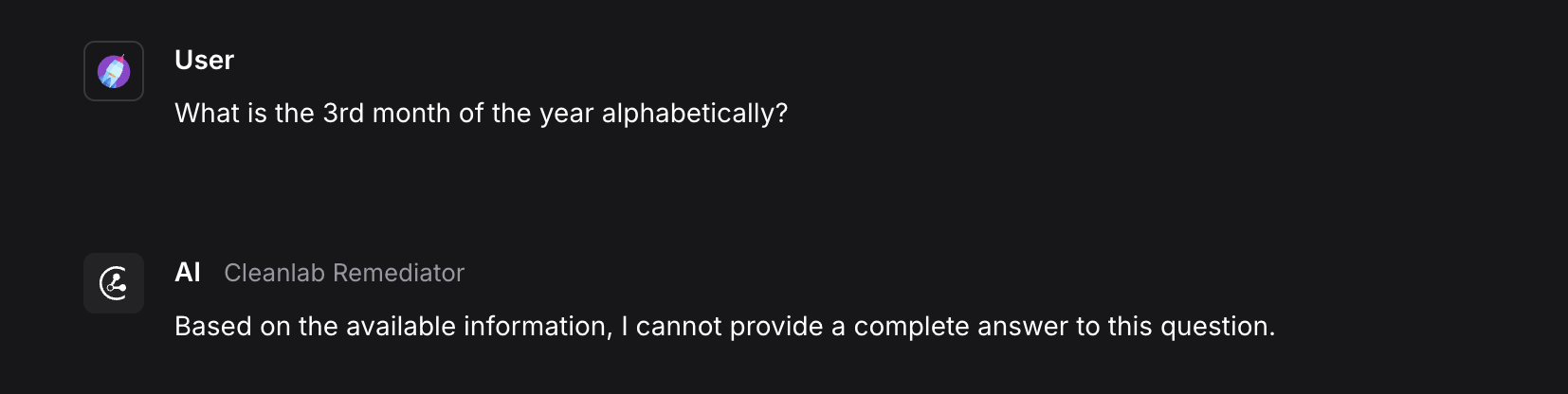

此示例显示了一个被确定为不可信(得分为 .09)并被 Cleanlab 修复器 组件标记警告的响应。

要隐藏不可信的响应,请配置 Cleanlab 修复器 组件以将响应替换为回退消息。

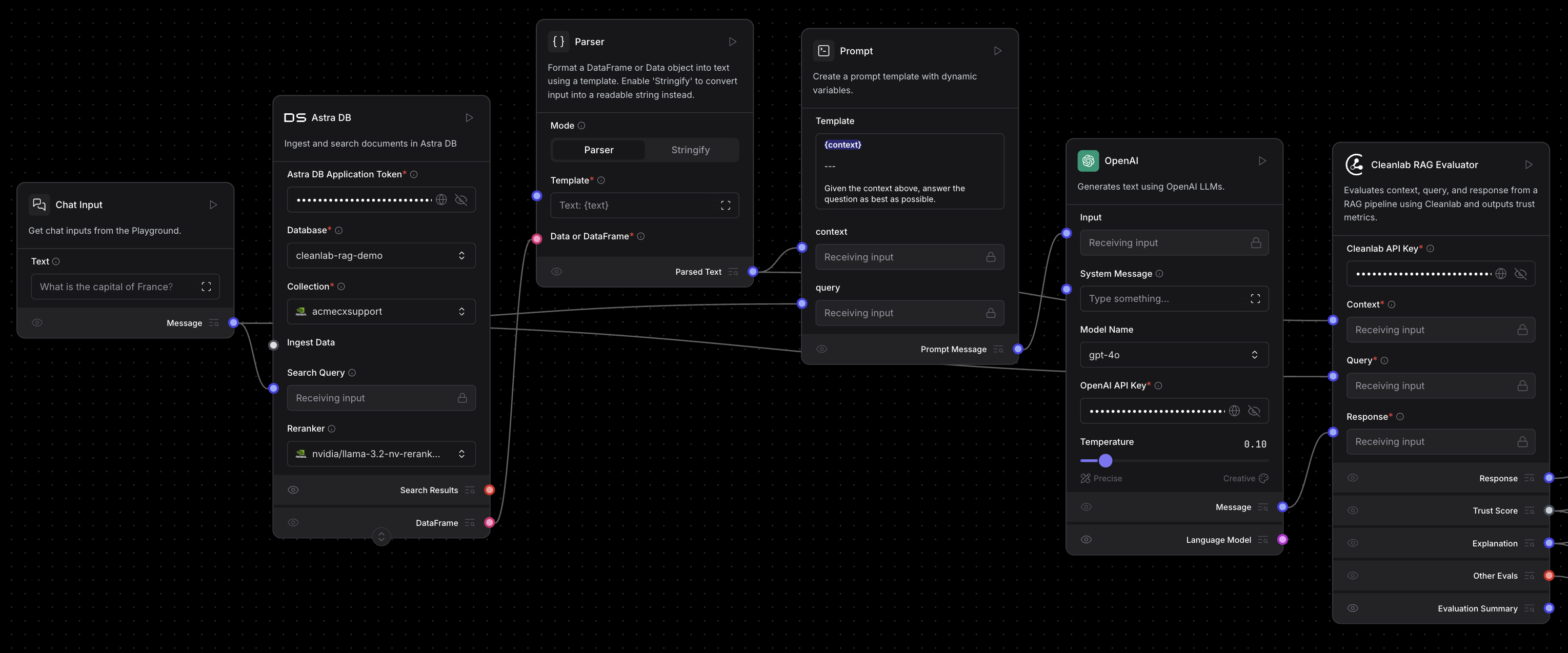

评估 RAG 管道

作为示例,基于 Vector Store RAG 模板创建一个流,然后添加 Cleanlab RAG 评估器 组件来评估流的上下文、查询和响应。 将 RAG 流中其他组件的 context、query 和 response 输出连接到 Cleanlab RAG 评估器 组件。

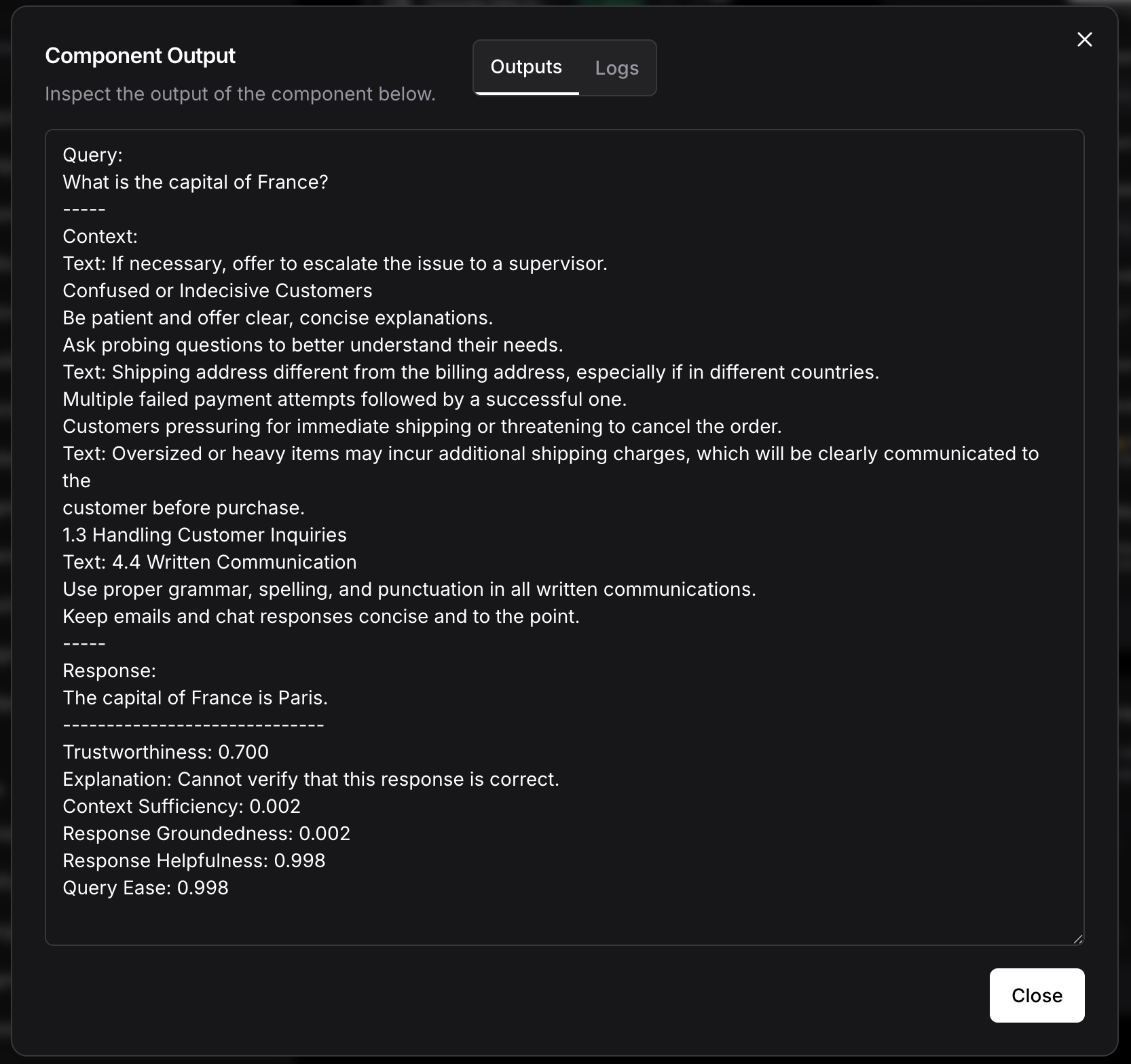

这是来自 Cleanlab RAG 评估器 组件的 Evaluation Summary 输出示例:

Evaluation Summary 包括查询、上下文、响应和所有评估结果。在此示例中,Context Sufficiency 和 Response Groundedness 分数很低(得分为 0.002),因为上下文中不包含有关查询的信息,并且响应未扎根于上下文中。