LLM 选择器 (LLM Selector)

在 Langflow 1.7 之前,此组件被称为 LLM 路由器 (LLM Router)。

LLM 选择器 (LLM Selector) 组件根据 OpenRouter 模型规格将请求路由到最合适的 LLM。

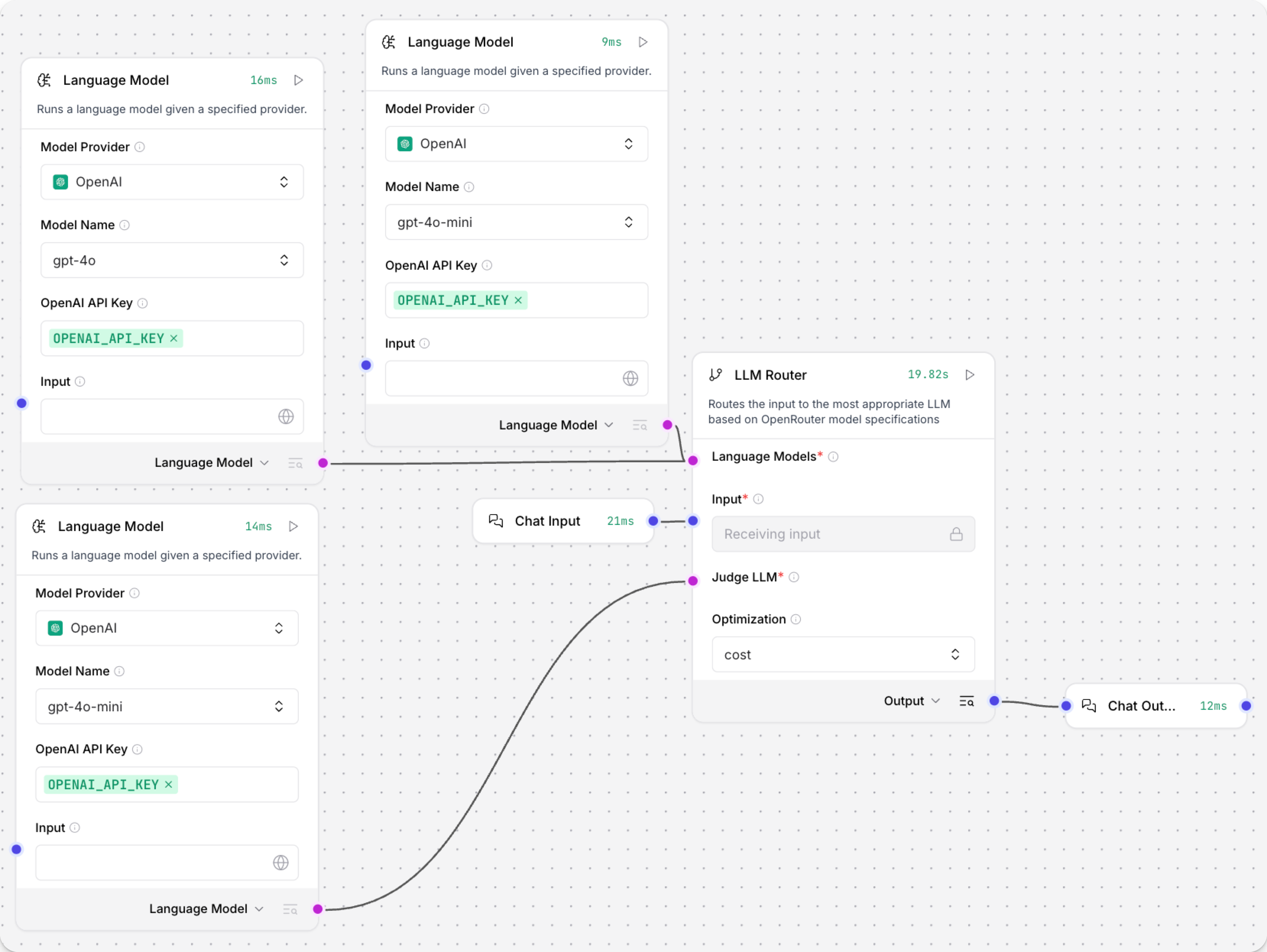

要在工作流中使用该组件,您需要将多个语言模型组件连接到 LLM 选择器 (LLM Selector) 组件。 其中一个模型是裁判 LLM,它分析输入消息以理解评估上下文,从其他连接的 LLM 中选择最合适的模型,然后将输入路由到选定的模型。 选定的模型处理输入,然后返回生成的响应。

以下示例工作流包含三个语言模型组件。 一个是裁判 LLM,另外两个在 LLM 池中用于请求路由。 输入和输出组件创建了一个无缝的聊天交互,您发送消息并接收响应,而用户完全感觉不到底层的路由过程。

LLM 选择器参数

Some parameters are hidden by default in the visual editor. You can modify all parameters through the Controls in the component's header menu.

| 名称 | 显示名称 | 信息 |

|---|---|---|

models | 语言模型 (Language Models) | 输入参数。连接来自多个 语言模型组件 的 LanguageModel 输出以创建一个模型池。judge_llm 在路由请求时从该池中选择模型。如果您连接的第一个模型在模型选择或路由出现问题时,将作为默认模型。 |

input_value | 输入 (Input) | 输入参数。要路由到由裁判 LLM 选定的模型的传入查询。 |

judge_llm | 裁判 LLM (Judge LLM) | 输入参数。连接 一个 语言模型 (Language Model) 组件的 LanguageModel 输出,作为请求路由的裁判 LLM。 |

optimization | 优化 (Optimization) | 输入参数。为裁判 LLM 的模型选择设置首选特性。选项包括 quality (质量)(最高响应质量)、speed (速度)(最快响应时间)、cost (成本)(最具成本效益的模型)或 balanced (平衡)(质量、速度和成本权重相等)。默认值:balanced |

use_openrouter_specs | 使用 OpenRouter 规格 (Use OpenRouter Specs) | 输入参数。是否从 OpenRouter API 获取模型规格。如果为 false,则仅向裁判 LLM 提供模型名称。默认:启用 (true) |

timeout | API 超时 (API Timeout) | 输入参数。为路由器发出的 API 请求设置超时时长(以秒为单位)。默认值:10 |

fallback_to_first | 回退到第一个模型 (Fallback to First Model) | 输入参数。如果路由无法到达选定的模型,是否使用 models 中的第一个 LLM 作为备份。默认:启用 (true) |

LLM 选择器输出

LLM 选择器 (LLM Selector) 组件提供三个输出选项。 您可以在组件输出端口附近设置所需的输出类型。

-

输出 (Output):一个

Message,包含由选定 LLM 生成的对原始查询的响应。 用于常规聊天交互。 -

选定模型信息 (Selected Model Info):一个

Data对象,包含有关选定模型的信息,例如其名称和版本。 -

路由决策 (Routing Decision):一个

Message,包含裁判模型选择特定模型的推理过程,包括输入查询长度和考虑的模型数量。 例如:_10模型选择决策:_10- 选定模型索引: 0_10- 选定 Langflow 模型名称: gpt-4o-mini_10- 选定 API 模型 ID (如果已解析): openai/gpt-4o-mini_10- 优化偏好: cost_10- 输入查询长度: 27 个字符 (~5 tokens)_10- 考虑的模型数量: 2_10- 规格来源: OpenRouter API如果您觉得裁判模型没有选择最佳模型,这对于调试非常有用。